På BUZZ HPC riktar vi strålkastarna mot banbrytande AI-forskning som levererar verkligt värde som du kan mäta i kronor och ören. I den här artikeln dyker vi in i MicroAdam – en banbrytande optimerare som låter dig finjustera större modeller på samma GPU utan att röra din arkitektur, dina data eller ens din batchstorlek.

Om du hyr H100s, H200s eller B200s från oss för modellträning kan MicroAdam vara skillnaden mellan att du behöver mer datorresurser eller minskar med 50 %

Optimeringsläge: Den dolda kostnaden i din GPU-minnesbudget

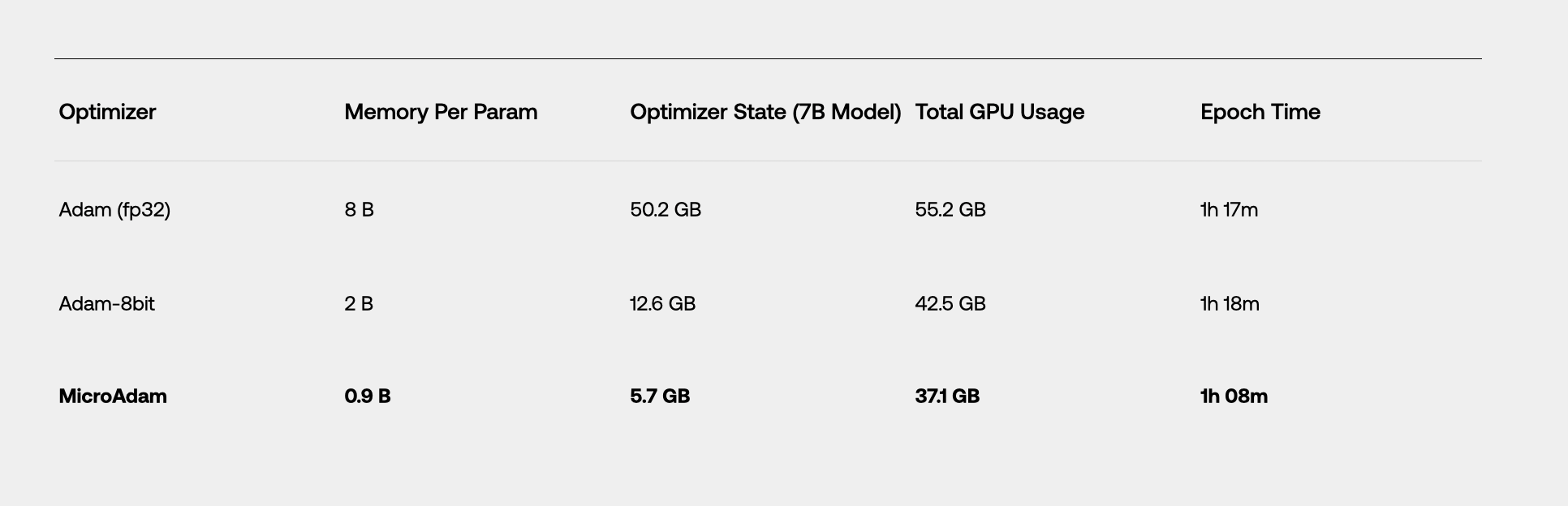

Om du finjusterar en stor modell idag är din minnesflaskhals förmodligen inte aktiveringar – det är optimeraren. Populära optimerare som Adam eller AdamW upprätthåller två 32-bitars tensorer (första och andra moment) för varje parameter i din modell.

Det innebär att varje 7B-parametermodell kostar ytterligare 50+ GB optimeringsläge, även när dina vikter är i bf16. På en 80 GB GPU är det en showstopper.

MicroAdam skriver om den ekvationen.

Vad är MicroAdam?

MicroAdam är en drop-in-ersättning för Adam/AdamW som introducerades på NeurIPS 2024. Det minskar optimeringsminnet till under 1 byte per parameter, samtidigt som fullständig noggrannhet bibehålls över standardriktmärken.

Installation:

Användning:

från ista_daslab_optimizers import MicroAdam

optimizer = MicroAdam(model.parameters(), lr=1e-4)

Under huven lagrar MicroAdam endast ett glesat fönster av de översta 1 % av gradienterna, förstärkt med en liten 4-bitars felkorrigerande buffert. Denna smarta design upprätthåller full prestanda på en bråkdel av minnets fotavtryck.

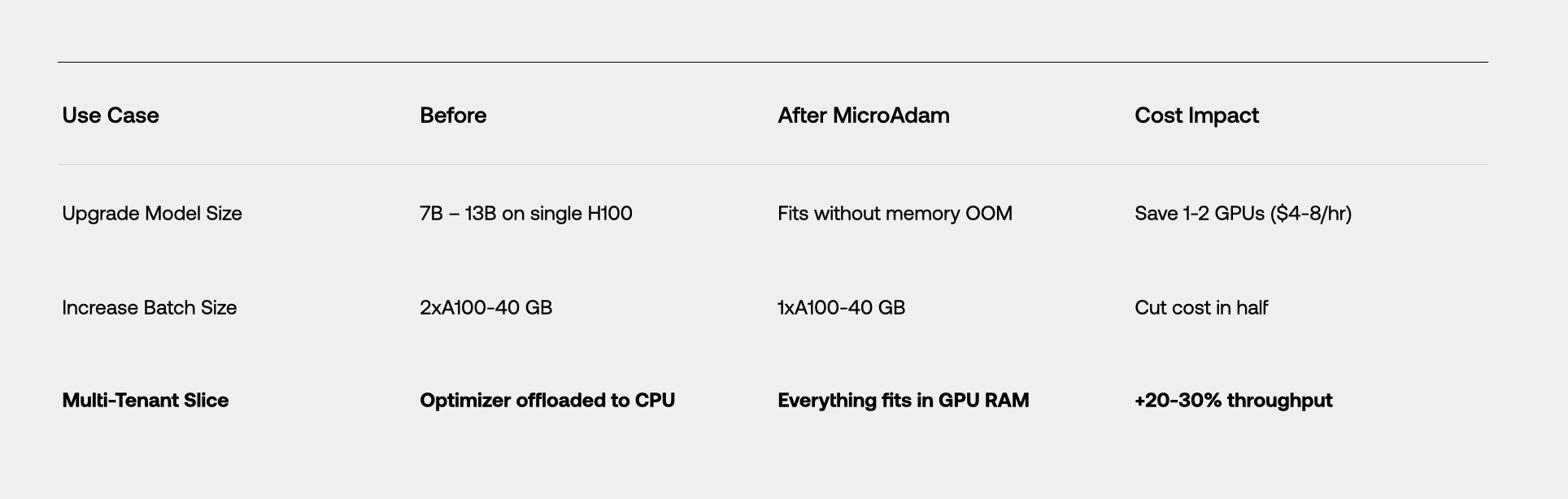

Verkliga fördelar för BUZZ HPC-klienter

Här är vad minnesbesparingen faktiskt betyder när du tränar på BUZZ HPC-infrastruktur:

För varje extra 5–10 GB du pressar ur optimeraren låser du upp mer beräkning för det som faktiskt betyder något: träningssignal och snabbare konvergens.

Var är haken?

Medan MicroAdam ser ut som en gratis uppgradering – och till stor del är det – finns det några viktiga förbehåll:

- Liten beräkningskostnad: Glesa operationer är något mer beräkningsintensiva än täta Adam-uppdateringar. I praktiken kan träningstiden minska på grund av bättre GPU-användning.

- Hyperparameterjustering: MicroAdam introducerar två nya knoppar – fönsterstorlek (m) och gleshetsnivå (k). Standardvärden (m=10, k=1 %) fungerar bra, men ytterligare justering kan förbättra resultaten.

- Ännu inte standard: När detta skrivs är MicroAdam inte inbyggd i HuggingFace Transformers eller DeepSpeed. Manuell integration kan krävas.

- Distribuerat träningsstöd: DDP och FSDP kräver små ändringar för att stödja MicroAdams glesa gradientuppdateringar – trivialt för avancerade användare, men inte helt plug-and-play (ännu).

Redo att distribueras på BUZZ HPC-infrastruktur

BUZZ HPC gör det enkelt att testa MicroAdam just nu:

✅ GPU-uthyrning på VM-nivå: Använd våra förbyggda PyTorch 2.x-containers med MicroAdam förinstallerat.

✅ Bare-metal H100/H200-servrar: Perfekt för kunder som går förbi 13B-modellstorlekar med finjusteringar med en GPU.

✅ Superkluster (B100/B200): Kombinera MicroAdam med blandad precision och lågbitsinferens för att pressa ut det högsta modell-per-dollar-förhållandet på planeten.

Är du osäker på var du ska börja? Vårt team kan hjälpa dig att dimensionera ditt kluster, välja en optimerare och maximera modellgenomströmningen per watt – allt på infrastruktur utformad för nästa generationens AI.