En BUZZ HPC, destacamos la investigación innovadora en IA que ofrece un valor real que se puede medir en dólares y céntimos. En este artículo, nos sumergimos en MicroAdam, un optimizador revolucionario que te permite ajustar modelos más grandes en la misma GPU sin tocar tu arquitectura, tus datos ni el tamaño de tu lote.

Si nos alquilas H100, H200 o B200 para el entrenamiento de modelos, MicroAdam puede marcar la diferencia entre necesitar más recursos informáticos o reducirlos en un 50 %.

Estado del optimizador: el coste oculto en el presupuesto de memoria de tu GPU

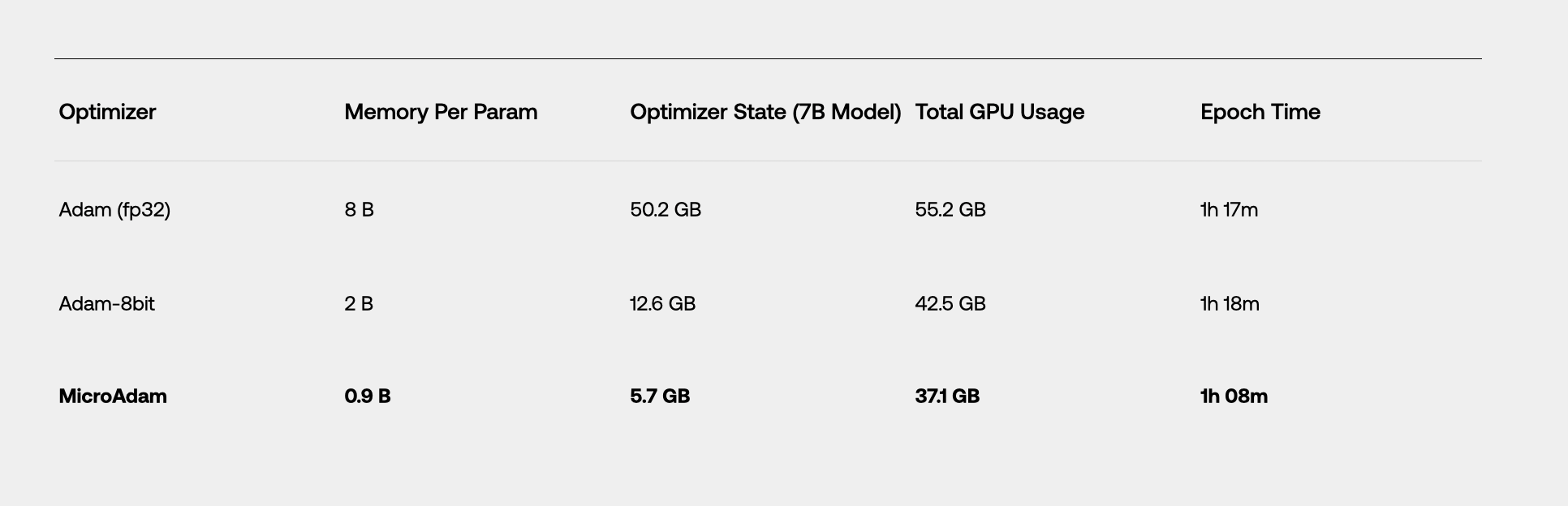

Si estás ajustando un modelo grande hoy, el cuello de botella de la memoria probablemente no sean las activaciones, sino el optimizador. Los optimizadores populares como Adam o AdamW mantienen dos tensores de 32 bits (primer y segundo momento) para cada parámetro del modelo.

Eso significa que cada modelo de 7000 millones de parámetros cuesta más de 50 GB adicionales de estado del optimizador, incluso cuando el peso está en bf16. En una GPU de 80 GB, eso es un problema.

MicroAdam reescribe esa ecuación.

¿Qué es MicroAdam?

MicroAdam es el sustituto directo de Adam/AdamW presentado en NeurIPS 2024. Reduce la memoria del optimizador a menos de 1 byte por parámetro, al tiempo que mantiene la precisión de rango completo en todos los puntos de referencia estándares.

Instalación:

Uso:

from ista_daslab_optimizers import MicroAdam

optimizer = MicroAdam(model.parameters(), lr=1e-4)

En el fondo, MicroAdam solo almacena una pequeña ventana del 1 % de los gradientes más altos, aumentada con un pequeño búfer de corrección de errores de 4 bits. Este diseño inteligente mantiene un rendimiento de rango completo con muy poca huella de memoria.

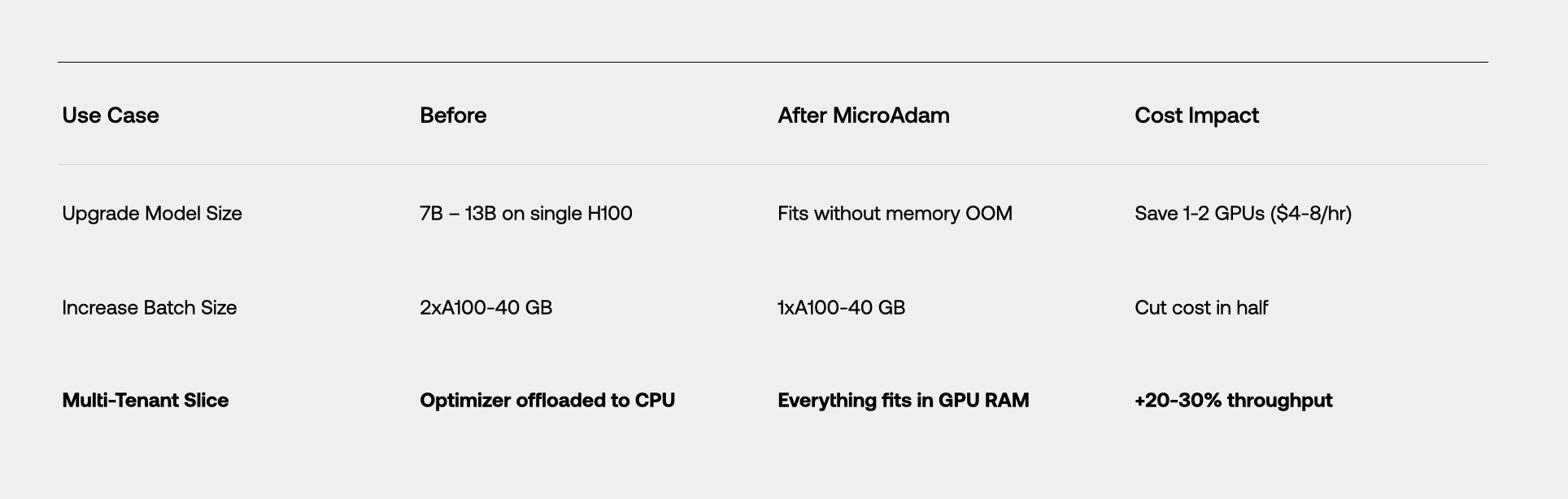

Ventajas reales para los clientes de BUZZ HPC

Esto es lo que ese ahorro de memoria realmente significa cuando entrenas en la infraestructura de BUZZ HPC:

Por cada 5-10 GB adicionales que se extraigan del optimizador, se accederá a más capacidad de computación para lo que realmente importa: la señal de entrenamiento y una convergencia más rápida.

¿Dónde está el truco?

Aunque MicroAdam parece una actualización gratuita, y en gran medida lo es, hay algunas advertencias importantes:

- Ligera sobrecarga de cálculo: las operaciones dispersas requieren un poco más de cálculo que las actualizaciones densas de Adam. En la práctica, el tiempo de entrenamiento puede disminuir debido a una mejor utilización de la GPU.

- Ajuste de hiperparámetros: MicroAdam introduce dos nuevos parámetros: el tamaño de la ventana (m) y el nivel de dispersión (k). Los valores predeterminados (m=10, k=1 %) funcionan bien, pero un ajuste adicional puede mejorar los resultados.

- Aún no es estándar: en el momento de redactar este documento, MicroAdam no está integrado en HuggingFace Transformers ni en DeepSpeed. Puede ser necesaria una integración manual.

- Soporte de entrenamiento distribuido: DDP y FSDP requieren pequeños cambios para admitir las actualizaciones de gradientes dispersos de MicroAdam, algo trivial para los usuarios avanzados, pero no del todo «plug-and-play» (todavía).

Listo para implementarlo en la infraestructura de BUZZ HPC

BUZZ HPC hace que sea fácil probar MicroAdam ahora mismo:

✅ Alquiler de GPU a nivel de VM: utiliza nuestros contenedores PyTorch 2.x precreados con MicroAdam preinstalado.

✅ Servidores H100/H200 «bare-metal»: ideales para los clientes que superan los tamaños de modelo 13B anteriores con ajustes de una sola GPU.

✅ Superclústeres (B100/B200): combina MicroAdam con una inferencia de precisión mixta y de bajo bit para exprimir la relación modelo-dólar más alta del planeta.

¿No sabes por dónde empezar? Nuestro equipo puede ayudarte a dimensionar tu clúster, elegir un optimizador y maximizar el rendimiento del modelo por vatio, todo ello en una infraestructura diseñada para la IA de próxima generación.