Chez BUZZ HPC, nous mettons en lumière la recherche révolutionnaire en IA qui offre une valeur réelle que vous pouvez mesurer en dollars et en cents. Dans cet article, nous plongeons dans MicroAdam, un optimiseur révolutionnaire qui vous permet d’affiner des modèles plus grands sur le même GPU sans toucher à votre architecture, à vos données ou même à la taille de votre lot.

Si vous louez des GPU H100, H200 ou B200 auprès de BUZZ HPC pour l’entraînement de modèles, MicroAdam peut faire la différence entre devoir mobiliser davantage de ressources de calcul — ou réduire de 50 %.

État de l’optimiseur : le coût caché dans votre budget de mémoire GPU

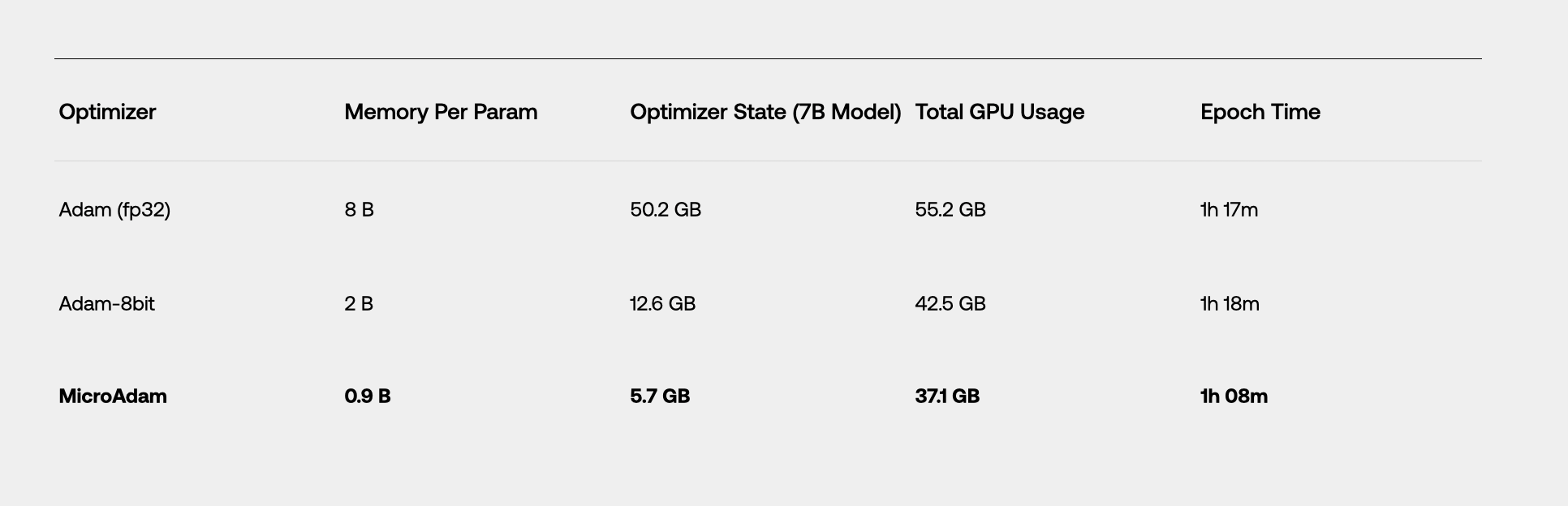

Si vous affinez aujourd’hui un modèle de grande taille, votre principal goulot d’étranglement en mémoire n’est probablement pas lié aux activations, mais à l’optimiseur. Les optimiseurs populaires comme Adam ou AdamW maintiennent deux tenseurs de 32 bits (premier et deuxième moments) pour chaque paramètre de votre modèle.

Cela signifie que chaque modèle de paramètre 7B coûte plus de 50 Go d’état d’optimiseur supplémentaire, même lorsque vos poids sont en bf16. Sur un GPU de 80 Go, c’est rédhibitoire.

MicroAdam réécrit cette équation.

Qu’est-ce que MicroAdam?

MicroAdam est un remplacement direct d’Adam/AdamW introduit à NeurIPS 2024. Il réduit la mémoire de l’optimiseur à moins de 1 octet par paramètre, tout en maintenant une précision de rang complet sur les points de référence standard.

Installation :

Utilisation :

from ista_daslab_optimizers import MicroAdam

optimizer = MicroAdam(model.parameters(), lr=1e-4)

Sous le capot, MicroAdam ne stocke qu’une fenêtre clairsemée du top 1 % des gradients, augmentée d’un minuscule tampon de correction d’erreur de 4 bits. Cette conception intelligente maintient des performances de rang complet sur une fraction de l’empreinte de la mémoire.

Avantages réels pour les clients BUZZ HPC

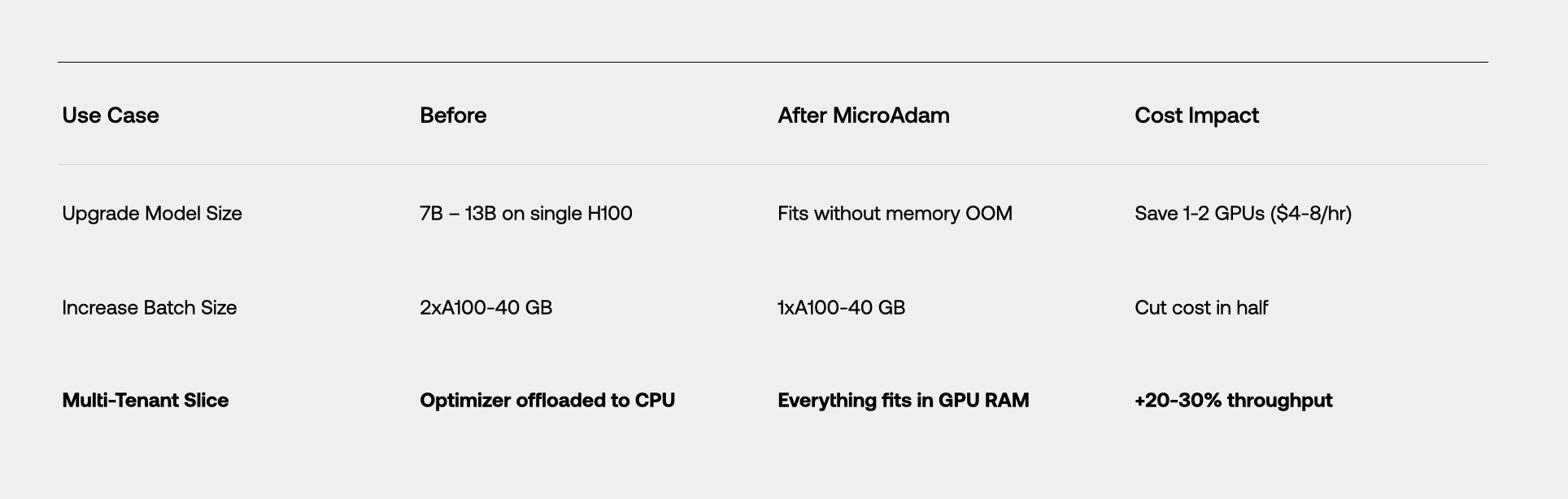

Voici ce que cette économie de mémoire signifie réellement lorsque vous vous entraînez sur l’infrastructure BUZZ HPC :

Pour chaque 5 à 10 Go supplémentaires que vous extrayez de l’optimiseur, vous débloquez plus de calcul pour ce qui compte réellement : le signal d’entraînement et une convergence plus rapide.

Où est le piège?

Bien que MicroAdam ressemble à une mise à niveau gratuite, et c’est largement le cas, il y a quelques mises en garde importantes :

- Léger surcoût de calcul : les opérations éparses sont légèrement plus gourmandes en calcul que les mises à jour denses d’Adam. En pratique, le temps d’entraînement peut diminuer en raison d’une meilleure utilisation du GPU.

- Réglage des hyperparamètres : MicroAdam introduit deux nouveaux boutons : la taille de la fenêtre (m) et le niveau de dispersion (k). Les valeurs par défaut (m=10, k=1 %) fonctionnent bien, mais un réglage supplémentaire peut améliorer les résultats.

- Pas encore standard : au moment de la rédaction, MicroAdam n’est pas intégré dans HuggingFace Transformers ou DeepSpeed. Une intégration manuelle peut être nécessaire.

- Support de l’entraînement distribué : DDP et FSDP demandent de petits ajustements afin de gérer les mises à jour de gradients sparsifiés de MicroAdam — simples pour des utilisateurs expérimentés, mais pas encore entièrement prêts à l’emploi.

Prêt à être déployé sur l’infrastructure BUZZ HPC

BUZZ HPC facilite le test de MicroAdam dès maintenant :

✅ Location de GPU au niveau de la VM : utilisez nos conteneurs PyTorch 2.x pré-construits avec MicroAdam pré-installé.

✅ Serveurs H100/H200 bare-metal : idéal pour les clients qui dépassent les tailles de modèle 13B avec des réglages précis à GPU unique.

✅ Superclusters (B100/B200) : combinez MicroAdam avec une précision mixte et une inférence à faible débit pour obtenir le ratio modèle par dollar le plus élevé de la planète.

Vous ne savez pas par où commencer ? Notre équipe peut vous aider à dimensionner votre cluster, à choisir un optimiseur et à maximiser le débit du modèle par watt, le tout sur une infrastructure conçue pour l’IA de nouvelle génération.